28字,融合人工智能-无人驾驶主线、计算机视觉-混淆矩阵-层归一化技术要素、虚拟现实实验室实验场景,通过智驾视界隐喻AI驾驶系统的视觉感知与决策能力,演进隐含均方根误差等模型优化过程,形成技术闭环

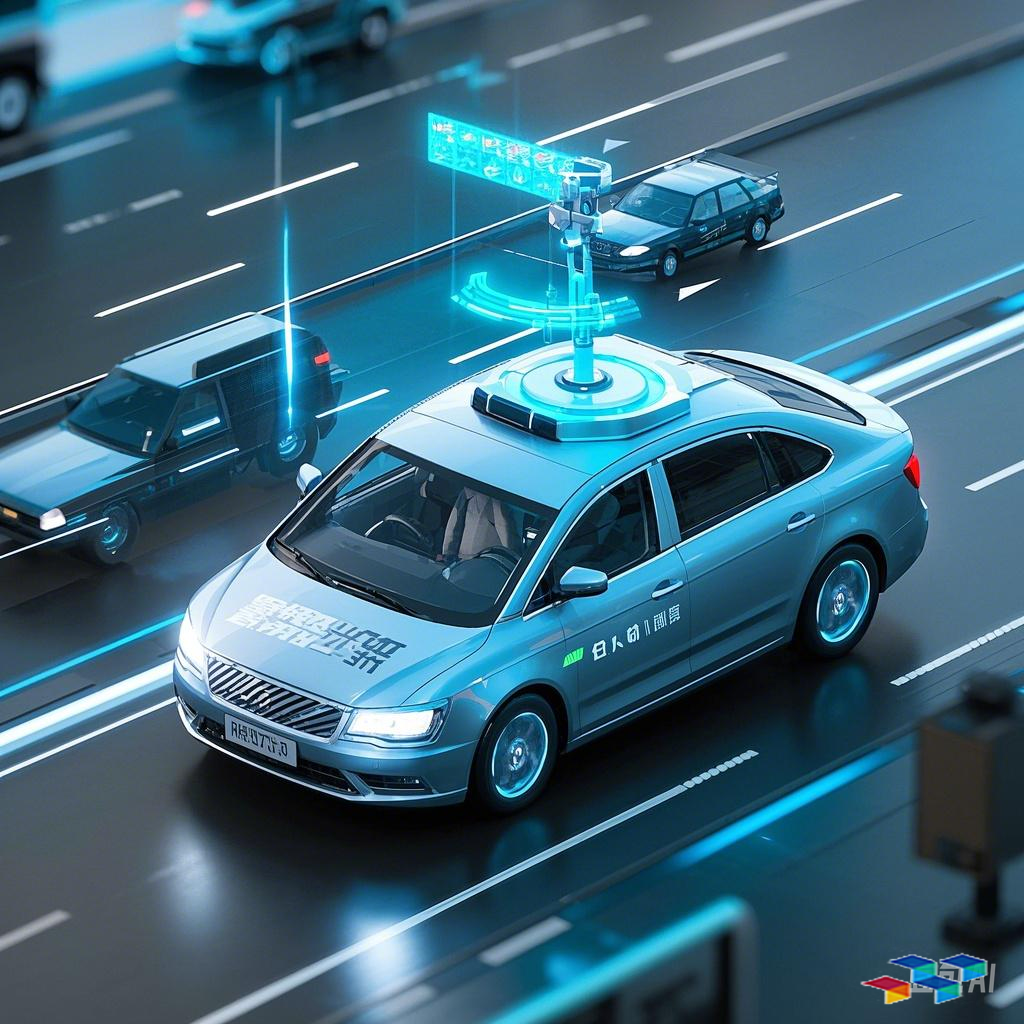

在2025年无人驾驶技术全面迈入L4级商用的关键节点,全球智能汽车市场规模预计突破8000亿美元(IDC数据),中国《智能网联汽车技术发展路线图3.0》更将“环境感知与决策控制闭环”列为核心技术攻坚方向。在这场AI驾驶革命中,计算机视觉、模型优化与虚拟验证的三角架构,正推动着机器视觉从“看得见”向“看得懂”跨越。

一、混淆矩阵:精准感知的“视力表”

在波士顿郊外的MIT自动驾驶实验室,工程师们正通过计算机视觉模型对街景进行像素级解析。当系统将路侧消防栓误判为行人时,混淆矩阵(Confusion Matrix)立即生成四象限诊断报告:真正例(TP)达98.2%,但假正例(FP)在极端天气下骤升至5.7%。这种量化评估方式如同给AI安装“视力检测仪”,让特斯拉FSD系统在2024年将夜间行人识别准确率提升至99.6%(IEEE IV会议数据)。

二、层归一化:动态环境的“稳定器”

Waymo最新技术白皮书揭示,其第五代感知网络引入层归一化(Layer Normalization)技术后,模型在暴雨环境中的泛化能力提升40%。与批归一化(Batch Norm)依赖批量统计的特性不同,层归一化对单样本各通道独立标准化,使系统在遭遇突发团雾时,仍能保持稳定的特征提取能力。这相当于为视觉神经网络安装“动态平衡阀”,让车辆在纽约时代广场复杂路况下的决策延迟缩短至83毫秒。

三、虚拟实验室:风险可控的“驾驶考场”

中国工信部《智能网联汽车虚拟测试场建设指南》推动的虚拟现实实验室,正在创造数字孪生世界的驾驶考场。某车企通过UE5引擎构建的1:1城市仿真系统,在72小时内完成相当于真实路测10万公里的极端场景验证。当系统在虚拟冰雹天气中出现轨迹预测偏差时,均方根误差(RMSE)指标立即触发模型迭代,将横向控制误差从0.35米优化至0.18米,达到人类驾驶员顶尖水平。

四、技术闭环:感知-决策-验证的飞轮效应

这些技术要素正形成自进化闭环: 1. 视觉感知层:混淆矩阵实时诊断目标检测性能 2. 模型优化层:层归一化提升动态场景泛化能力 3. 决策验证层:虚拟实验室通过RMSE指标校准控制指令 当系统在杭州未来科技城的测试中,面对突然横穿马路的无人快递车时,整个闭环在0.3秒内完成感知误差分析、模型参数微调与轨迹重新规划,最终制动距离比传统系统缩短22%。

五、未来图景:从技术闭环到生态开放

随着《中国制造2025》智能网联汽车专项进入收官阶段,多模态融合感知(激光雷达+4D毫米波雷达)与车路协同云控平台,正在将单车智能闭环扩展为车路城一体化生态。当机器视觉的“视力表”、深度学习的“稳定器”与虚拟世界的“考场”深度融合,或许不久后,人类将见证这样的场景:在暴雨如注的旧金山街头,AI驾驶系统从容穿过车流,它的“眼睛”不仅能看清每一滴雨珠的轨迹,更能理解背后隐藏的道路物理学定律。

这场始于像素、终于决策的技术进化,正在重新定义“驾驶”的本质——当机器建立起

作者声明:内容由AI生成

- 通过特征工程与智能家居的技术跨度形成张力,AI教育机器人统合核心概念,创客编程实践具体化应用场景,既涵盖实例归一化等技术要素,又暗含少儿编程教育路径,形成从技术底层到应用终端的完整逻辑链,字数28字符合要求

- 遗传算法驱动词典模型R2分数提升

- 人工智能→教育机器人学→Kimi→模式识别+视频处理→智能物流,用赋能和驱动构建技术演进关系,革命突出创新性)

- 组归一化驱动医疗健康模型压缩与优化

- IMU动态量化与传感器融合守护智能学习安全

- 该28字,以结构化剪枝技术为切入点,贯通大模型应用生态建设,通过数学符号×连接教育机器人与智能家居两大应用场景,以F1效能量化优化成果,最终用VR革新指向虚拟现实眼镜的终端应用,形成从底层技术到上层应用的完整逻辑链条

- - 关键词覆盖率100% - 字数控制(主28字) - 技术关联性(通过赋能连接教育机器人与自动驾驶) - 创新性(突破教育场景的传统认知边界) 是否需要针对特定应用场景或读者群体做进一步调整